Bester Video-Übersetzer im Jahr 2026

TABLE OF CONTENTS

KI-Videoübersetzung hat sich von einer Neuheit zu einem produktionsreifen Workflow entwickelt. Die besten Tools im Jahr 2026 können Ihre Stimme klonen, Ihre Lippen synchronisieren und Untertitelspuren in über hundert Sprachen liefern – und das zu einem Bruchteil der Kosten, die traditionelle Synchronstudios verlangen. Aber nicht jedes Tool beherrscht alle drei Aspekte gleichermaßen gut, und welches Sie wählen sollten, hängt davon ab, welche Art von Video Sie erstellen und wer es sich ansieht.

Kurze Antwort

Für die meisten Kreatoren und kleinen Teams bietet HeyGen die beste Balance aus Sprachabdeckung (175+), Lippen-Synchronisationsqualität und erschwinglicher Preisgestaltung. Wenn die Sprachqualität das wichtigste Kriterium ist, produziert ElevenLabs die natürlich klingendsten synchronisierten Audios. Wenn Sie einen ausgereiften, unternehmensgerechten Workflow mit KI-Avataren und Synchronisation an einem Ort benötigen, ist Synthesia die stärkste Wahl.

Falls Ihr Hauptbedarf darin besteht, Untertiteldateien zu übersetzen und nicht komplette Videos zu synchronisieren, sehen Sie sich unsere speziellen Leitfäden zu wie man Untertitel übersetzt und den besten SRT-Übersetzer im Jahr 2026 an.

Empfehlungen:

- Beste Gesamtoption für Kreatoren: HeyGen

- Beste Sprachqualität: ElevenLabs

- Beste Video-Plattform für Unternehmen: Synthesia

- Beste All-in-One-Lokalisierung: Rask AI

- Beste Option für Live- und Echtzeit-Synchronisation: CAMB.AI

- Budgetfreundlichster Editor mit Synchronisation: Kapwing

- Beste Option für textbasierte Untertitelübersetzung: OpenL

Hinweis: OpenL ist unser Produkt. Es wird hier aufgeführt, da es Untertitel- und Textübersetzungen unterstützt, die Teil des Videoübersetzungs-Workflows sind. Wir weisen darauf klar hin und machen die Kompromisse sichtbar. Dieser Artikel enthält keine Affiliate-Links.

Warum Videoübersetzung jetzt anders ist

Vor zwei Jahren bedeutete KI-Videoübersetzung automatisch generierte Untertitel mit maschinell übersetztem Text. Das war nützlich, aber es war nicht das, was die meisten Menschen heute meinen, wenn sie sagen: „Übersetze mein Video“.

Im Jahr 2026 hat sich die Erwartungshaltung verändert. Kreator:innen möchten, dass ihre Videos so klingen, als wären sie ursprünglich in der Zielsprache aufgenommen worden. Das bedeutet, dass drei Dinge gleichzeitig passieren müssen:

1. Sprachübergreifendes Voice Cloning. Die besten Tools können jetzt Ihre Stimme aus einem Quellvideo nehmen und sie in einer anderen Sprache reproduzieren, wobei Tonfall, Tonhöhe und Sprechstil erhalten bleiben. Dies ist nicht mehr experimentell – Plattformen wie HeyGen, Synthesia und Rask AI bieten alle produktionsreife Voice-Cloning-Technologie.

2. Lippen-Synchronisation. Synchronisierte Audios, die nicht mit den Mundbewegungen übereinstimmen, erzeugen einen „Uncanny Valley“-Effekt, der das Vertrauen der Zuschauer:innen in die Inhalte beeinträchtigt. Die besten Tools im Jahr 2026 behandeln Lippen-Synchronisation als eine zentrale Funktion und passen die visuelle Ausgabe an die neue Tonspur an.

3. Kontextbewusste Übersetzung. Eine einfache Wort-für-Wort-Übersetzung funktioniert bei Videos nicht, da gesprochene Sprache informell, idiomatisch und kontextabhängig ist. Die neueren KI-Modelle bewältigen dies besser, da sie auf Konversationsdaten und nicht nur auf geschriebenen Text trainiert sind.

Der Kostenunterschied ist enorm. Traditionelle professionelle Synchronisation kostet $100–300 pro fertiger Minute und benötigt 2–3 Wochen Bearbeitungszeit. KI-Tools liefern Ergebnisse in Minuten für $2–10 pro Minute, abhängig von der Plattform und dem Funktionsumfang.

Wie wir diese Tools bewertet haben

Dieser Vergleich basiert auf offizieller Produktdokumentation, veröffentlichten Preisübersichten und verifizierten Drittanbieterbewertungen, Stand März 2026. Wir haben dokumentierte Fähigkeiten gegenüber Marketingaussagen priorisiert.

Wir haben folgende Faktoren gewichtet:

- Übersetzungs- und Synchronisationsqualität: Wie natürlich klingt das Ergebnis in der Zielsprache?

- Lippensynchronität: Passt das Tool die visuellen Mundbewegungen an die synchronisierte Audioausgabe an?

- Stimmenklonung: Kann es die Stimme des ursprünglichen Sprechers über verschiedene Sprachen hinweg bewahren?

- Sprachabdeckung: Wie viele Sprachen werden unterstützt, und wie gut funktionieren weniger verbreitete Sprachen?

- Untertitel-Verarbeitung: Kann es Untertitelspuren erstellen, übersetzen und einbetten?

- Preistransparenz: Ist das Preismodell verständlich und vorhersehbar?

- Workflow-Einfachheit: Wie viele Schritte sind nötig, um vom Hochladen bis zum fertig übersetzten Video zu gelangen?

HeyGen — Beste Wahl für Kreative

HeyGen ist das umfassendste Video-Übersetzungstool im Jahr 2026. Es unterstützt über 175 Sprachen und Dialekte – mehr als jede andere Plattform in diesem Vergleich. Der Kern-Workflow ist einfach: Video hochladen, Zielsprache auswählen, und HeyGen übernimmt automatisch die Transkription, Übersetzung, Stimmenklonung und Lippensynchronisation.

Stärken:

- Stimmenklonung, die Ihre stimmliche Identität in allen unterstützten Sprachen bewahrt

- Lippensynchronisation, die besonders gut für sprechende Personen funktioniert

- Automatisch generierte Untertitel, die Zuschauer ein- oder ausschalten können

- Erkennung mehrerer Sprecher für Videos mit mehreren Personen

- Kostenloses Angebot, das bis zu 3 Videos pro Monat (jeweils bis zu 3 Minuten) erlaubt

Schwächen:

- Kreditbasiertes Preismodell erschwert die Vorhersage der monatlichen Kosten

- Credits verfallen monatlich und können nicht übertragen werden

- Erweiterte Funktionen wie lippensynchronisierte Übersetzung verbrauchen Premium-Credits schneller

- Weniger geeignet für Inhalte wie Dokumentationen oder Bildschirmaufnahmen, die keine sprechenden Personen enthalten

Preise:

- Kostenlos: 3 Videos/Monat, jeweils bis zu 3 Minuten

- Creator: $24/Monat (jährliche Abrechnung)

- Pro: $79/Monat (jährliche Abrechnung)

- Business: $149/Monat + $20 pro zusätzlichem Nutzer

Audio-Dubbing ist bei allen kostenpflichtigen Plänen unbegrenzt, aber lippen-synchronisierte Übersetzungen und andere Premium-Funktionen verbrauchen Credits.

Am besten geeignet für: YouTube-Creator, Kursanbieter und Marketing-Teams, die schnell ein Publikum in vielen Sprachen erreichen möchten.

ElevenLabs — Beste Sprachqualität

ElevenLabs begann als Text-to-Speech-Unternehmen und hat sich auf Dubbing ausgeweitet – und diese Herkunft zeigt sich. Die Sprachqualität ist eine Klasse besser als bei allen anderen Tools in diesem Vergleich. Die synchronisierten Audios von ElevenLabs bewahren nicht nur die Stimme des Sprechers, sondern auch dessen emotionale Ausdrucksweise – Pausen, Betonungen und Intonation werden über Sprachgrenzen hinweg so übertragen, dass sie wirklich menschlich klingen.

Stärken:

- Die realistischsten KI-Stimmen auf dem Markt, mit emotionaler Nuance, die über Sprachen hinweg erhalten bleibt

- Dubbing Studio verarbeitet Inhalte mit mehreren Sprechern

- Unterstützung von 29 Sprachen durch ihr mehrsprachiges Modell

- API-Zugriff für Entwickler, die Dubbing in ihre eigenen Workflows integrieren möchten

- Günstiger Einstiegspunkt mit dem Starter-Plan für $5/Monat

Schwächen:

- Nur Audio – keine Lippen-Synchronisation oder Video-Bearbeitungsfunktionen

- 29 Sprachen sind deutlich weniger als bei HeyGen oder Rask AI

- Ein separates Tool ist erforderlich, um die visuelle Seite der Videoübersetzung zu bearbeiten

- Die kostenlose Version hat Wasserzeichen und begrenzte Minuten

Preise:

- Kostenlos: Begrenzte Minuten, Wasserzeichen im Output

- Starter: $5/Monat (30 Minuten Audiogenerierung)

- Creator: $22/Monat

- Höhere Pläne verfügbar für professionelle und geschäftliche Nutzung

Am besten geeignet für: Podcaster, Hörbuchproduzenten und Creator, die Sprachqualität über alles priorisieren und bereit sind, die Videobearbeitung separat zu erledigen.

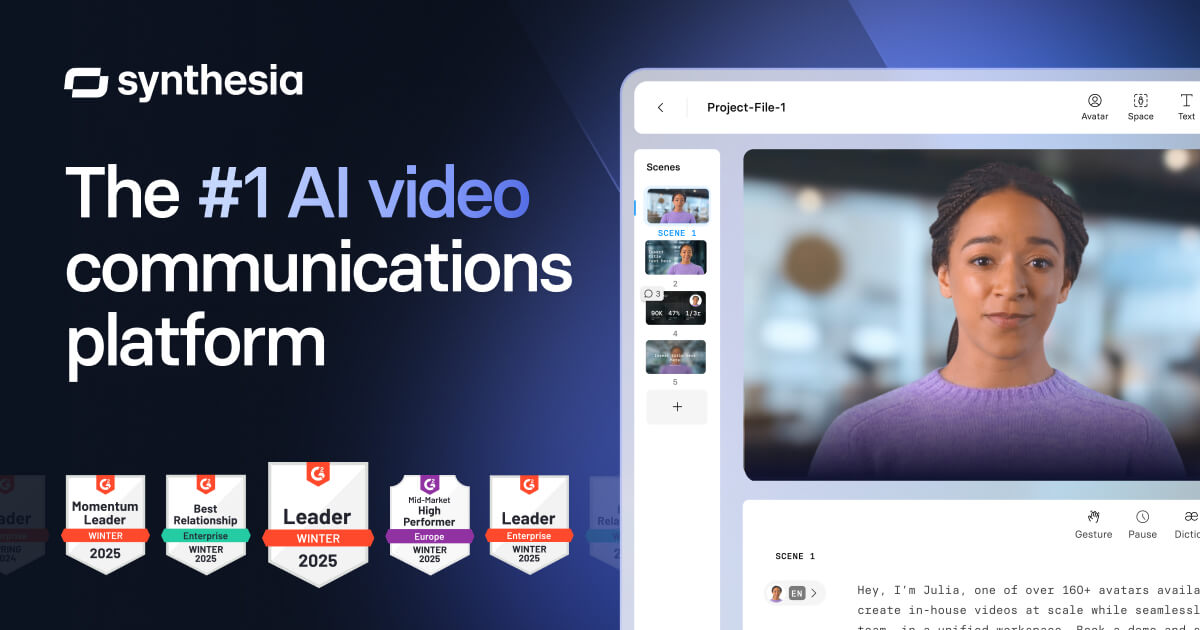

Synthesia — Beste Enterprise-Videoplattform

Synthesia ist nicht nur ein Videoübersetzer – es ist eine vollständige KI-Videoerstellungsplattform, die Synchronisation als eine ihrer Funktionen umfasst. Was Synthesia besonders macht, ist die Kombination aus KI-Avataren, Stimmklonung und Lippen-Synchronisation in einer einzigen, benutzerfreundlichen Oberfläche. Für Unternehmen, die Schulungsvideos, Produktdemos oder Unternehmenskommunikation in mehreren Sprachen erstellen müssen, bietet Synthesia das umfassendste Paket.

Was es gut macht:

- KI-Avatare, die Inhalte in mehreren Sprachen mit natürlicher Lippen-Synchronisation präsentieren können

- Stimmwiedergabe über alle unterstützten Sprachen hinweg

- 1-Klick-Übersetzung in über 80 Sprachen bei Enterprise-Plänen

- Automatisch generierte Untertitel mit Umschaltsteuerung im Multilingual Player

- SOC 2-Konformität und Sicherheitsfunktionen auf Unternehmensniveau

- Über 95 % Übersetzungsgenauigkeit für gängige Sprachen

Wo es Schwächen hat:

- Das Credits-System begrenzt die Nutzung, und zusätzliche Credits können nicht während des Zyklus gekauft werden

- Studio-Avatare kosten zusätzlich 1.000 $ pro Jahr

- 1-Klick-Übersetzung und SCORM-Export sind nur im Enterprise-Tarif verfügbar

- Weniger geeignet für die Übersetzung bestehender Aufnahmen – am stärksten bei der Erstellung neuer Videos mit KI-Avataren

Preise:

- Kostenlos: ~10 Minuten Video (1.200 Credits/Monat)

- Starter: 18 $/Monat (jährlich) oder 29 $/Monat (monatlich), 120 Minuten/Jahr

- Creator: 64 $/Monat (jährlich) oder 89 $/Monat (monatlich), ~360 Minuten/Jahr

- Enterprise: Individuelle Preisgestaltung, unbegrenzte Minuten

Am besten geeignet für: Teams für Unternehmensschulungen, HR-Abteilungen und Unternehmen, die mehrsprachige Videoinhalte in großem Umfang mit konsistenter Markenführung erstellen müssen.

Rask AI — Beste All-in-One-Lokalisierung

Rask AI positioniert sich als umfassende Lokalisierungsplattform, und diese Positionierung ist treffend. Es deckt die gesamte Pipeline ab – von Transkription über Übersetzung bis hin zu synchronisiertem Voice-Cloning mit Lippenbewegung – alles in einer einzigen webbasierten Oberfläche. Für Teams, die ein Tool statt drei benötigen, ist Rask AI die kohärenteste Option.

Was es gut macht:

- Vollständiger Workflow: Transkription, Übersetzung, Synchronisation und Lippenbewegung in einer Plattform

- Erkennung mehrerer Sprecher, die automatisch verschiedene Stimmen identifiziert und klont

- Voice-Cloning in 32 der über 135 unterstützten Sprachen

- Export von SRT/VTT-Untertiteln zusammen mit synchronisierten Videos

- Gute Balance zwischen Qualität und Erschwinglichkeit für den professionellen Einsatz

Wo es Schwächen hat:

- API-Zugriff ist generell auf Enterprise-Pläne beschränkt

- Die Qualität des Voice-Clonings variiert bei weniger verbreiteten Sprachen

- Weniger granulare Bearbeitungsmöglichkeiten im Vergleich zu Tools wie Kapwing

- Lernkurve für die vollständige Nutzung des Funktionsumfangs

Preise:

Rask AI verwendet ein gestaffeltes Abonnementmodell mit minutengenauer Abrechnung. Kostenlose Testversionen sind verfügbar, um die Qualität vor einer Verpflichtung zu prüfen. Die genauen Preiskategorien ändern sich häufig, daher sollten Sie die offizielle Preisseite für aktuelle Tarife überprüfen. Die Pläne reichen im Allgemeinen von Creator-Level ($20–50/Monat) bis Enterprise ($200+/Monat).

Am besten geeignet für: Marketingteams und Content-Agenturen, die Videos regelmäßig in mehrere Sprachen lokalisieren müssen.

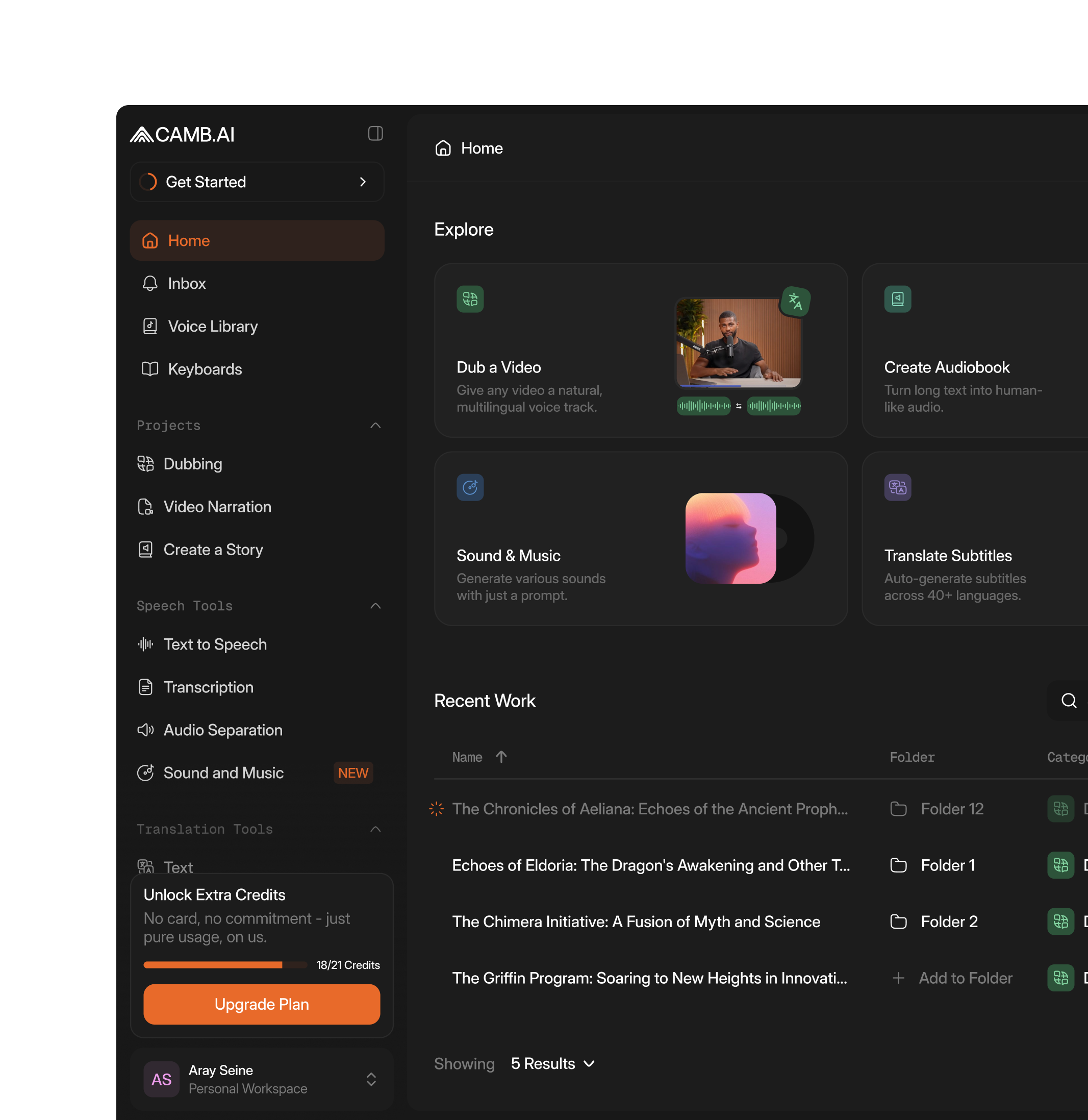

CAMB.AI — Am besten für Live- und Echtzeit-Synchronisation

CAMB.AI sticht durch eine Fähigkeit hervor, die kein anderes Tool in diesem Vergleich auf demselben Niveau bietet: Echtzeit-Synchronisation. Ihr Produkt DubStream kann Live-Audio- und Videostreams übersetzen, weshalb Eurovision Sport mit ihnen zusammengearbeitet hat, um Live- und On-Demand-Untertitelung für die Paralympischen Winterspiele Milano Cortina 2026 bereitzustellen.

Was es gut macht:

- Echtzeit-Synchronisation mit DubStream für Live-Übertragungen und Events

- Unterstützung für über 140 Sprachen

- Realistische Stimmen, die sich gut für Live-Szenarien eignen

- Infrastruktur auf Unternehmensniveau für Medienoperationen mit hohem Volumen

- Partnerschaftsvalidierung mit führenden Rundfunkorganisationen

Schwächen:

- Hauptsächlich auf Unternehmen ausgerichtet, nicht für einzelne Kreatoren konzipiert

- Preise sind nicht öffentlich gelistet – erfordert Kontaktaufnahme mit dem Vertrieb

- Weniger intuitiv für einfache einmalige Videoübersetzungen

- Dokumentation ist dünner als bei kreatorenorientierten Tools

Preise:

Individuelle Unternehmenspreise. Kontaktieren Sie das Vertriebsteam für ein Angebot.

Am besten geeignet für: Medienunternehmen, Rundfunkanstalten und Eventveranstalter, die Echtzeit-Mehrsprachensynchronisation für Live-Inhalte benötigen.

Kapwing — Der beste budgetfreundliche Editor mit Synchronisationsfunktion

Kapwing ist in erster Linie ein Online-Videoeditor, der KI-gestützte Synchronisations- und Übersetzungsfunktionen hinzugefügt hat. Wenn Sie ein Tool benötigen, das sowohl Videoediting als auch Übersetzung in einem Browser-Tab vereint, ist Kapwing die zugänglichste Option. Es bietet nicht die Sprachqualität von ElevenLabs oder die Sprachvielfalt von HeyGen, gleicht dies jedoch durch eine übersichtliche Bearbeitungsoberfläche und angemessene Preise aus.

Stärken:

- Kombinierte Video-Bearbeitung und Übersetzung auf einer Plattform

- KI-Synchronisation mit automatischer Lippenbewegung in über 100 Sprachen

- Erkennung mehrerer Sprecher für präzise Synchronisation

- Sprachklonung für konsistente Voiceovers

- Funktion „Translation Rules“ zur Steuerung der Übersetzung von Namen und Markennamen

- „Smart Cut“-Funktion, die automatisch Pausen und Füllwörter entfernt

Schwächen:

- Die Qualität der Synchronisation liegt eine Stufe unter spezialisierten Tools wie HeyGen oder ElevenLabs

- Der Pro-Plan beschränkt die Synchronisation auf 50 Minuten Standard-Synchronisation pro Monat

- 40+ Sprachen für Synchronisation sind weniger als bei den meisten spezialisierten Übersetzungstools

- Nicht geeignet für Lokalisierungs-Workflows mit hohem Volumen

Preise:

- Kostenlos: Unbegrenzte Exporte mit Wasserzeichen, 720p-Qualität

- Pro: 16 $/Monat pro Mitglied (jährlich) oder 24 $/Monat (monatlich), 300 Minuten automatische Untertitelung

- Business: 50 $/Monat pro Mitglied (jährlich) oder 64 $/Monat (monatlich), 900 Minuten automatische Untertitelung

- Enterprise: Individuelle Preisgestaltung

Am besten geeignet für: Einzelne Kreative und kleine Teams, die grundlegende Synchronisation direkt im Video-Editor wünschen.

VideoDubber — Bestes kostenloses Angebot

VideoDubber bietet etwas Ungewöhnliches in diesem Bereich: einen wirklich nützlichen kostenlosen Plan. Es kombiniert die APIs von Google Translate, OpenAI und DeepL für Übersetzungen und unterstützt über 150 Sprachen für Synchronisation und Untertitel. Die Qualität erreicht nicht das Niveau von Premium-Tools, aber für Kreative, die erste Erfahrungen sammeln oder mit knappen Budgets arbeiten, ist es ein solider Einstiegspunkt.

Stärken:

- Kostenloser Plan umfasst KI-gestützte Video-/Audio-Übersetzung, Untertitel, Synchronisation, Stimmenklonen und Text-to-Speech

- Unterstützung für über 150 Sprachen

- Mehrere Übersetzungs-Engines (Google, OpenAI, DeepL) für höhere Genauigkeit

- Niedrige Einstiegshürde für Experimente mit Videoübersetzungen

Schwächen:

- Die Ausgabequalität variiert stark je nach Sprachpaar

- Weniger ausgereifte Benutzeroberfläche im Vergleich zu HeyGen oder Synthesia

- Begrenzte erweiterte Funktionen wie Lippen-Synchronisation in kostenlosen Plänen

- Abhängigkeit von Drittanbieter-APIs bedeutet, dass die Qualität von den Upstream-Anbietern abhängt

Preise:

Kostenloser Plan mit grundlegenden Funktionen verfügbar. Bezahlte Pläne bieten höhere Limits und zusätzliche Funktionen. Aktuelle Preise finden Sie auf der Website.

Am besten geeignet für: Kreative mit begrenztem Budget, die Videoübersetzung ausprobieren möchten, bevor sie sich für ein kostenpflichtiges Tool entscheiden.

OpenL — Am besten für die Übersetzung von Untertiteln

Nicht jede Videoübersetzungsaufgabe erfordert eine Synchronisation. Wenn Ihr Workflow das Übersetzen von Untertiteldateien — SRT, VTT oder einfache Texttranskripte — und deren anschließenden Import in Ihren Videoeditor umfasst, erledigt OpenL diesen Teil effizient.

OpenL übersetzt Untertiteldateien und bewahrt dabei Zeitstempel und Formatierungen, was bedeutet, dass Sie von Untertiteln in der Ausgangssprache zu Untertiteln in der Zielsprache wechseln können, ohne die Zeitstempel manuell anpassen zu müssen. Es unterstützt über 100 Sprachen und übernimmt den Textübersetzungsschritt, der im Kern jedes Video-Lokalisierungs-Workflows steht.

Für den vollständigen Workflow zur Untertitelübersetzung sehen Sie sich unsere Anleitungen zu wie man Untertitel übersetzt, wie man VTT-Dateien übersetzt und den besten SRT-Übersetzer im Jahr 2026 an.

Was es gut macht:

- Saubere Übersetzung von Untertiteldateien mit Erhalt der Zeitstempel

- Unterstützt SRT, VTT und andere gängige Untertitelformate

- Über 100 Sprachen mit gleichbleibender Qualität

- Einfacher Hochladen-und-Übersetzen-Workflow

- Erschwingliche Preise für textbasierte Übersetzungen

Wo es Schwächen hat:

- Keine Synchronisation, Stimmenklonung oder Lippen-Synchronisation — es ist ein Textübersetzungstool

- Sie benötigen ein separates Tool für die Audio-/Videoproduktion

- Kein Ersatz für vollständige Videoübersetzungsplattformen

Am besten geeignet für: Kreative, die bereits einen Video-Editing-Workflow haben und nur präzise Untertitelübersetzungen benötigen.

Vergleichstabelle

| Tool | Sprachen | Synchronisation | Lippen-Synchronisation | Sprachklonung | Untertitel | Kostenloses Angebot | Startpreis |

|---|---|---|---|---|---|---|---|

| HeyGen | 175+ | Ja | Ja | Ja | Ja | 3 Videos/Monat | $24/Monat |

| ElevenLabs | 29 | Nur Audio | Nein | Ja | Nein | Eingeschränkt + Wasserzeichen | $5/Monat |

| Synthesia | 80+ | Ja | Ja | Ja | Ja | ~10 Min./Monat | $18/Monat |

| Rask AI | 135+ | Ja | Ja | Ja (32 Sprachen) | Ja | Testversion verfügbar | ~$20/Monat |

| CAMB.AI | 140+ | Ja (live) | Ja | Ja | Ja | Nein | Individuell |

| Kapwing | 100+ | Ja | Ja | Ja | Ja | Mit Wasserzeichen | $16/Monat |

| VideoDubber | 150+ | Ja | Eingeschränkt | Ja | Ja | Ja | Variiert |

| OpenL | 100+ | Nein | Nein | Nein | Ja | Ja | Variiert |

Wie man den richtigen Video-Übersetzer auswählt

Das beste Tool hängt von Ihrem spezifischen Anwendungsfall ab. Hier ist ein Entscheidungsrahmen:

Wählen Sie HeyGen, wenn Sie ein Content Creator sind, der sprechende Kopf-Videos in viele Sprachen mit guter Lippen-Synchronisation und Sprachklonung übersetzen muss. Es bietet die größte Sprachunterstützung und eine vernünftige kostenlose Testversion.

Wählen Sie ElevenLabs, wenn die Sprachqualität Ihre oberste Priorität ist und Sie bereit sind, die Videoproduktion separat zu bearbeiten. Am besten geeignet für Podcasts, Hörbücher und Audio-zentrierte Inhalte.

Wählen Sie Synthesia, wenn Sie ein Unternehmen sind, das Schulungs- oder Unternehmensvideos produziert und KI-Avatare + Synchronisation in einer Plattform benötigt. Die Enterprise-Funktionen (SSO, Compliance, unbegrenzte Minuten) rechtfertigen den höheren Preis für größere Teams.

Wählen Sie Rask AI, wenn Sie ein Tool für die gesamte Lokalisierungspipeline — Transkription, Übersetzung, Synchronisation und Lippen-Synchronisation — ohne die Notwendigkeit, mehrere Dienste zusammenzuführen, suchen.

Wählen Sie CAMB.AI, wenn Sie Echtzeit-Synchronisation für Live-Übertragungen oder Veranstaltungen benötigen. Kein anderes Tool in diesem Vergleich bietet Live-Übersetzung auf diesem Niveau.

Wählen Sie Kapwing, wenn Sie eine grundlegende Synchronisation direkt in Ihrem Video-Editor wünschen und keine höchste Ausgabequalität benötigen. Ideal für Social-Media-Inhalte und schnelle Bearbeitungen.

Wählen Sie OpenL, wenn Ihr Workflow auf Untertiteln basiert und Sie eine präzise Textübersetzung mit Zeitstempel-Erhaltung benötigen. Kombinieren Sie es mit Ihrem bestehenden Video-Editor für einen vollständigen Workflow.

Was ist mit YouTubes integrierter Übersetzung?

YouTube bietet automatisch generierte Untertitel und von der Community beigetragene Übersetzungen, aber diese sind nicht mit den oben genannten Tools vergleichbar. Die automatischen Untertitel von YouTube sind nützlich für Barrierefreiheit, aber nicht für professionelle Lokalisierung konzipiert. Sie bieten keine Synchronisation, Stimmklonung oder Lippenbewegungsanpassung.

Wenn Sie auf YouTube veröffentlichen und internationale Zielgruppen erreichen möchten, sieht der typische Workflow so aus:

- Verwenden Sie ein Tool wie HeyGen oder Rask AI, um synchronisierte Versionen Ihres Videos zu erstellen

- Laden Sie jede Sprachversion als separates Video hoch oder nutzen Sie die Multi-Audio-Track-Funktion von YouTube

- Verwenden Sie OpenL oder ein ähnliches Tool, um Ihre Videobeschreibung, den Titel und die Tags zu übersetzen

Für die Übersetzung von YouTube-Kommentaren und Interaktionen in der Community, lesen Sie unseren Leitfaden zu YouTube-Kommentar-Phrasen und was sie wirklich bedeuten.

Preisübersicht

Die Kosten für KI-gestützte Videoübersetzung im Jahr 2026 reichen von kostenlos (mit Einschränkungen) bis hin zu mehreren hundert Dollar pro Monat für den Unternehmenseinsatz. Hier ist eine grobe Übersicht:

Kostenlose oder nahezu kostenlose Optionen:

- HeyGen kostenloses Paket (3 Videos/Monat)

- VideoDubber kostenloser Plan

- Kapwing kostenloses Paket (mit Wasserzeichen)

- ElevenLabs kostenloses Paket (eingeschränkt + Wasserzeichen)

$5–25/Monat (für Einzelpersonen):

- ElevenLabs Starter ($5/Monat)

- Kapwing Pro ($16/Monat)

- Synthesia Starter ($18/Monat)

- HeyGen Creator ($24/Monat)

- ElevenLabs Creator ($22/Monat)

$50–150/Monat (für professionelle Teams):

- Synthesia Creator ($64/Monat)

- HeyGen Pro ($79/Monat)

- Kapwing Business ($50/Monat)

- HeyGen Business ($149/Monat)

$200+/Monat (Enterprise):

- Synthesia Enterprise (kundenspezifisch)

- CAMB.AI (kundenspezifisch)

- Rask AI Enterprise (kundenspezifisch)

Vergleichen Sie dies mit traditionellen Synchronstudios, die $100–300 pro fertiger Minute berechnen. Ein 10-minütiges Video, das in einem traditionellen Studio $1.000–3.000 kosten würde, kann mit KI-Tools für weniger als $50 übersetzt werden – und wird in Minuten statt Wochen geliefert.

Häufige Fehler, die vermieden werden sollten

1. Überspringen der Überprüfung. KI-Synchronisation ist gut, aber nicht perfekt. Überprüfen Sie immer die übersetzten Inhalte, insbesondere Namen, Zahlen, Fachbegriffe und kulturelle Referenzen, die KI-Modelle häufig falsch behandeln.

2. Ignorieren der Lippenbewegung bei sprechenden Personen. Wenn Ihr Video eine Person zeigt, die spricht, führt synchronisierte Audiodaten ohne Lippenbewegungsanpassung zu einer Diskrepanz, die Zuschauer sofort bemerken. Verwenden Sie ein Tool, das eine Lippenbewegungsanpassung beinhaltet.

3. Annahme, dass alle Sprachen gleich gut funktionieren. Die Qualität der KI-Synchronisation variiert erheblich zwischen den Sprachen. Große Sprachen wie Spanisch, Französisch, Chinesisch und Deutsch liefern gute Ergebnisse. Weniger verbreitete Sprachen können deutlich niedrigere Qualität aufweisen. Testen Sie immer zuerst mit einem kurzen Clip.

4. Verwendung eines einzigen Tools für alles. Manchmal ist der beste Workflow die Kombination von zwei Tools: eines für die Synchronisation (HeyGen, ElevenLabs) und eines für die Untertitelübersetzung (OpenL). Der Versuch, ein einziges Tool für alles zu verwenden, kann zu Kompromissen führen.

5. Vergessen der kulturellen Anpassung. Übersetzung bedeutet nicht nur, Wörter zu übertragen. Humor, Redewendungen, Maßeinheiten und Datumsformate müssen lokalisiert werden. Die besten KI-Tools erledigen einen Teil davon automatisch, aber eine menschliche Überprüfung fängt das auf, was die KI übersieht.

Was als Nächstes kommt

Der Bereich der KI-Videoübersetzung entwickelt sich rasant. Basierend auf aktuellen Trends können Sie in den nächsten 12–18 Monaten mit folgenden Entwicklungen rechnen:

- Bessere Emotionenübertragung: Sprachklonung, die nicht nur die Stimme des Sprechers, sondern auch seinen emotionalen Zustand – Begeisterung, Sarkasmus, Besorgnis – über Sprachgrenzen hinweg einfängt

- Echtzeitübersetzung für Videotelefonie: Tools wie CAMB.AI arbeiten bereits an Lösungen für Übertragungen; bald wird dies auch alltägliche Videokonferenzen erreichen

- Automatische kulturelle Anpassung: KI-Modelle, die nicht nur die Sprache, sondern auch kulturelle Referenzen, Humor und Beispiele für unterschiedliche Zielgruppen anpassen

- Niedrigere Preise: Im mittleren Preissegment sind bereits deutliche Preisrückgänge zu beobachten, und der Wettbewerb wird die Preise branchenweit weiter senken

Fazit

Der beste Videoübersetzer im Jahr 2026 hängt davon ab, was Sie übersetzen und wer zusieht. Für die meisten Content-Ersteller bietet HeyGen die beste Kombination aus Sprachunterstützung, Lippen-Synchronisation und Preisgestaltung. Für Puristen in Sachen Sprachqualität ist ElevenLabs unübertroffen. Für Unternehmen integriert Synthesia das Synchronisieren in eine vollständige Videoproduktionsplattform. Und für workflows, die sich auf Untertitel konzentrieren, ermöglicht die Kombination von OpenL mit Ihrem bestehenden Editor eine präzise Textübersetzung, ohne Ihren Prozess zu verändern.

Egal, welches Tool Sie wählen, die Lücke zwischen KI-übersetzten Videos und professionell synchronisierten Inhalten hat sich dramatisch verkleinert. Die Frage ist nicht mehr, ob KI-Videoübersetzung gut genug ist – sondern welches Tool am besten zu Ihrem Workflow passt.